Mencegah Salahguna Deepfake, Lewat Perlindungan Hak Wajah dan Suara

- Dengan perlindungan negara terhadap data milik individu, berarti penggunaannya di hilir --sebagai produksi deepfake yang legal maupun ilegal, juga penggunaan data untuk keperluan pengembangan algoritma, maupun pelatihan AI dan sejenisnya, harus seizin pemilik datanya.

Kolom & Foto

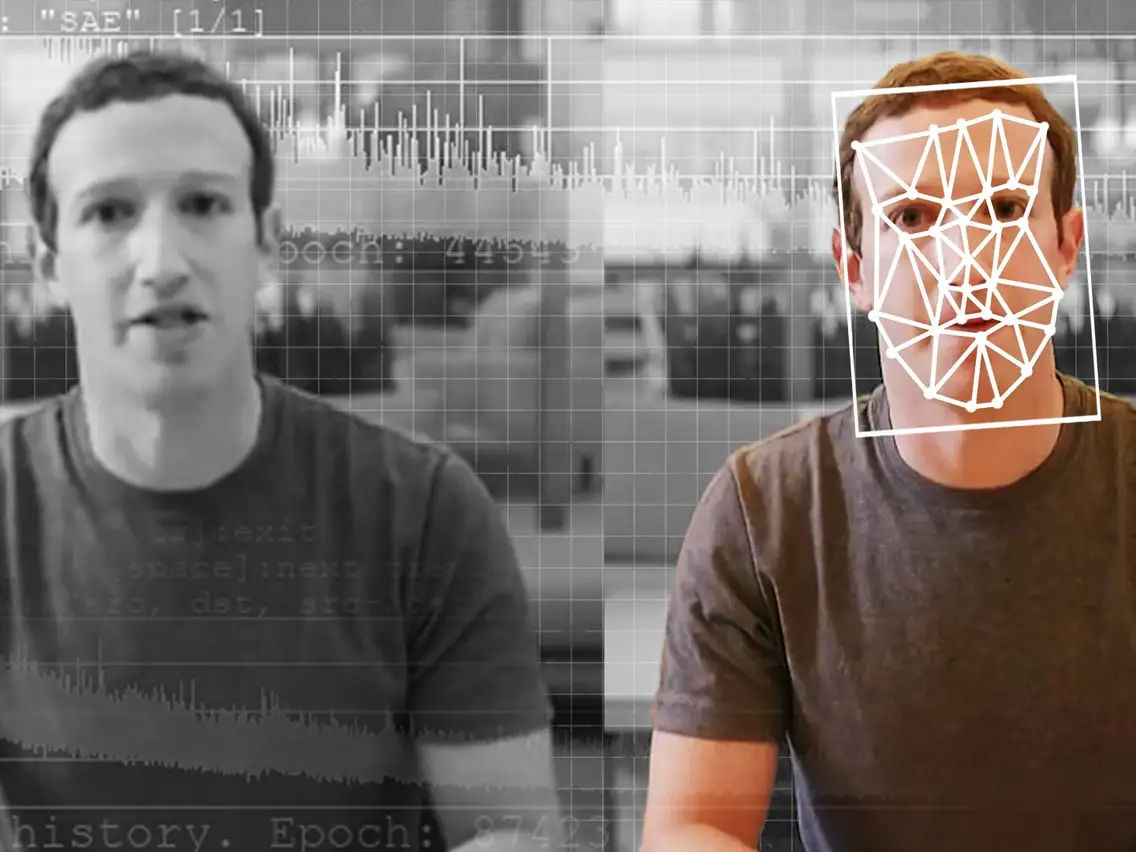

Awalnya Pemerintah Denmark hendak melindungi warga negaranya dari deepfake yang disalahgunakan. Kreasi berbasis artificial intelligence (AI) --yang mampu mengimitasi suara, wajah maupun gerakan tubuh individu—ini, berbahan baku hak milik individu. Hak milik yang selama ini dianggap unsur biologis ikutan belaka. Pada perkembangan teknologinya yang pesat, produk deepfake makin sulit dibedakan dari material yang ditirukannya. DiversityNews, 3 Juli 2025, berjudul “Denmark Leads the Way: Copyright for Faces and Voices as a Protection of Personal Identity” memberitakan perihal itu. Sebagai cara mengatasi penyalahgunaan yang merugikan warga negaranya.

Denmark memang sedang menata kembali struktur hukumnya. Bahkan bersifat radikal. Di antaranya ditandai penyusunan rancangan undang-undang (RUU). yang mengakui wajah maupun suara warga negaranya sebagai hak kekayaan intelektual. Implikasinya, data yang bersumber dari karakterisitik biologis individu itu tak dapat dimanfaatkan menggunakan AI, tanpa izin pemiliknya. Terlebih digunakan untuk produksi deepfake yang ilegal.

Dalam realitas hari ini, deepfake tak selalu bertujuan legal juga baik. Tak jarang produksinya bertujuan membangun realitas palsu, demi lancarnya tindakan kejahatan. Juga untuk mengeruk keuntungan ekonomi maupun kemenangan politik secara tidak sah. Ini sering disertai kerusakan. Kerusakan harga diri, kepercayaan masyarakat, maupun kerukunan antar warga negara, akibat beredarnya ketakpastian. Kepeloporan Pemerintah Denmark, menganggap wajah dan suara sebagai karya cipta yang dilindungi, berimplikasi luas.

Setidaknya ekspresi musisi maupun senimannya terhindar dari eksploitasi tanpa izin. Dan yang terpenting --wajah maupun suara yang tak lagi dianggap sekadar komponen biologis ikutan belaka-- merupakan pengakuan negara pada tubuh dalam makna budaya, sosial, dan pribadi yang berharga. Perlindungan penuh rasa hormat ini, mencegah tersalinnya identitas digital individu secara ilegal. Mencegah hak warga negara dilecehkan.

Secara teknis, deepfake dapat diproduksi ketika bahan bakunya --berupa data-- telah tersedia. Data ini merupakan hasil terjemahan karakterisitik wajah, suara, juga gerakan tubuh seseorang. Sumbernya berserakan: foto di akun WhatsApp maupun media sosial yang tak dilindungi, suara sebagai konten media sosial maupun Podcast, video yang beredar di Youtube. Juga semua jejak digital yang tertinggal, yang dapat diolah. Karenanya, yang paling kerap menjadi sasaran penyalahgunaan deepfake, adalah individu-individu yang data karakteristik biologisnya tersedia di berbagai medium: pesohor, selebritas, olahragawan maupun politisi.

Data --berupa bentuk, garis kerutan, hingga tarikan wajah saat seseorang berbicara, marah atau tersenyum-- bersifat khas. Demikian pula dengan nada, tone, jenis, maupun intonasi suara. Termasuk tubuh yang diam maupun bergerak, seluruhnya mengandung karakteristik unik itu. Saat informasi karakteristik biologis itu diurai, unsur pembentuknya kembali: berupa data. Yang dengan perangkat penyimpan dan penganalisis berkapasitas besar, seluruhnya dapat dipolakan sebagai algoritma. Algoritma ini memfasilitasi produksi tiruannya. Tampilannya jadi tak terbedakan dari aslinya, ketika bahan bakunya memenuhi seluruh unsur 6V --volume, variety, velocity, value, veracity, wariability data.

Kinza Yasar, 2025, dalam “What is Deepfake Tecnology?”, menyebut deepfake sebagai jenis penerapan AI untuk menciptakan gambar, video, maupun rekaman audio tiruan yang meyakinkan. Istilah ini menggambarkan teknologi dan konten yang dihasilkan, sebagai gabungan dari pembelajaran mendalam dan kemampuan penciptaan tiruan. Deepfake dibuat menggunakan algoritma, dari rekaman lama maupun baru. Rekaman yang isinya karakterisitik --wajah seseorang dalam gambar, juga suara yang diperdengarkannya-- yang dianalisis machine learning (ML), untuk diproduksi materialnya dalam konteks yang lain.

Terdapat dua algoritma yang terlibat dalam produksi deepfake. Generator dan diskriminator. Algoritma generator membangun rangkaian data pelatihan. Ini didasarkan pada produk yang ingin dihasilkan maupun rancangan konten tiruannya. Sedangkan algoritma diskriminator, menganalisis tingkat kerealistisan atau kemiripan tiruan dengan versi aslinya. Prosesnya terus berulang, memungkinkan generator meningkatkan kemampuannya menciptakan konten yang realistis. Juga diskriminator yang menjadi lebih terampil dalam menemukan kekurangan yang harus diperbaiki generator.

Lewat proses sejenis di atas, dunia pernah heboh oleh kasus-kasus produksi deepfake yang menyesatkan. Setidaknya mengaburkan realitas. Di antaranya dikemukakan Sara Jodka, 2024, dalam tulisannya ”Manipulating Reality: The Intersection of Deepfakes and The Law”, yang menyebut adanya gambar Taylor Swift hasil produksi AI, sedang beraktiivtas seksual dan ditampilkan di X. Deepfake ini tampil lebih dari 45 juta kali, 24.000 repost dan ratusan ribu likes, serta bookmark selama hampir 17 jam sebelum akhirnya diturunkan. Namun penurunannya tak menghentikan penyebaran gambarnya di berbagai akun dan perangkat media sosial. Ini menyebabkan kerugian, berupa kerusakan harga diri individu yang ditampikan.

Sedangkan Ritesh Shetty, 2025, dalam “Top 10 Terrifying Deepfake Examples”, yang mengemukakan di antaranya: terjadinya ledakan di Pentagon yang mengakibatkan guncangan besar. Guncangan ini, akibat deepfake yang tersebar pada Mei 2023, berupa gambar yang tampak asli menunjukkan ledakan di dekat Pentagon. Ledakan disertai kepulan asap hitam, dari gedung milik pemerintah itu. Seluruhnya memunculkan spekulasi terjadinya serangan teroris atau rudal.

Keadaannya menjadi kian mencekam, saat penyebaran gambar makin intensif lewat akun-akun Twitter yang terverifikasi. Juga dimuat agregator berita keuangan dan dilaporkan oleh media arus utama. Akibatnya, terjadi penurunan yang cepat di pasar saham AS berikut merosotnya S&P 500, hingga berita palsu itu dibantah. Penyebaran deepfake seperti itu, merusak kepercayaan masyarakat, yang berimbas pada kinerja ekonomi.

Sedangkan deepfake yang menyebabkan kerusakan kerukunan antar warga negara, terjadi saat beredar video yang mengisahkan penangkapan mantan presiden AS Donald Trump. Dan ternyata, video palsu. Namun walaupun palsu, kehebohannya nyata: antar warga negara AS berdebat runcing, membahas kebenaran isi video. Peristiwa itu terjadi pada Maret 2023, saat foto-foto hasil produksi AI yang menggambarkan mantan Presiden AS Donald Trump, ditangkap paksa. Seluruh konten itu, awalnya diunggah oleh seniman Eliot Higgins, pendiri Bellingcat.

Motif pengunggahannya, untuk membangun interpretasi spekulatif dan satir tentang kemungkinan penangkapan Trump. Namun tentu saja, motif yang semula main-main tak sepenuhnya dapat dikendalikan. Video itu dengan cepat keluar dari konteksnya, menyebar ke berbagai perangkat digital lain dan membesar tanpa penyangkalan. Ini membelah warga negara AS: antara bingung atau yakin.

Contoh-contoh di atas, memang mengemukakan kasus-kasus penyalahgunaan deepfake yang mengaburkan realitas, dan terjadi di AS. Negara ini merupakan salah satu negara paling menonjol di dunia dalam pengembangan AI-nya. Ini selain Cina, Inggris, Israel, Canada maupun Jerman. Dan paralel dengan kemenonjolan itu, penyalahgunaan deepfake juga melesat jumlah kasusnya. Namun seluruhnya sama sekali tak berarti, kasus-kasus semacam itu hanya terjadi di negara dengan perkembangan AI yang menonjol.

Indonesia sebagai negara sedang berkembang, termasuk ekosistem AI-nya, menurut VIDA, 2025, dalam penelitiannya yang berjudul “VIDA Where’s The Fraud - Protecting Indonesia Business from AI Generated Fraud”, mengalami lonjakan penipuan deepfake yang mencapai 1540% kasus. Penipuan yang utamanya menimpa bidang keuangan ini, terjadi dari tahun 2022 hingga 2023. Dan di awal tahun 2025, penipuan dengan memanfaatkan deepfake mengetengahkan Presiden Prabowo Subianto yang mengumumkan adanya program bantuan finansial dari pemerintah.

Yang untuk bantuan itu, calon penerimanya dipersyaratkan mentransfer uang yang besarnya antara Rp 250rb hingga Rp 1 juta. Ini menjadi biaya administrasi awal. Tentu saja dalam waktu singkat, kepalsuan segera terkuak. Narasi presiden dan bantuan itu, adalah penipuan. Otoritas pemerintah menyangkal adanya bantuan itu, setelah dikonfirmasi. Hanya saja, kerugian yang mencapai jutaan rupiah pada korban-korban yang mempercayainya telah terjadi.

Maka untuk mencegah terulangnya penyalahgunaan deepfake, strategi yang dilakukan Pemerintah Denmark dapat dikaji serius oleh semua negara di seluruh dunia. Argumentasinya, hulu sumber data untuk produksi deepfake adalah individu-individu warga negara. Dengan perlindungan negara terhadap data milik individu, berarti penggunaannya di hilir --sebagai produksi deepfake yang legal maupun ilegal, juga penggunaan data untuk keperluan pengembangan algoritma, maupun pelatihan AI dan sejenisnya, harus seizin pemilik datanya.

Tanpa izin itu, penggunannya ilegal dan berkonsekuensi hukum. Karenanya, ketika ini diterapkan --alih-alih hanya deepfake ilegal yang dapat dikendalikan-- seluruh pemanfaatan data individu harus seizin pemiliknya. Karena memang data itu, punya tuan yang harus dihormati kepemilikannya. Itu makna kedaulatan kan?